Modelos

De maneira a tentar padronizar as atividades relacionadas a investigação forense, diversos modelos são propostos, apresentando técnicas e procedimentos para a análise de dispositivos e sistemas digitais. A seguir, podemos acompanhar um pouco dos modelos existentes.

NiJ DoD

Modelo de análise forense digital, o NIJ-DoD foi desenvolvido pelo Instituto Nacional de Justiça (National Institute of Justice - NIJ) americano, como um dos primeiros do seu gênero, servindo de base para muitos outros que vieram posteriormente.

Sua metodologia consiste na divisão do processo forense de evidência digital em Avaliação, Aquisição, Exame e Documentação, este último presente em todas as etapas do processo. Além delas, o modelo prevê um estágio inicial de desenvolvimento de procedimento.

Por ser um processo bastante dividido e subdivido, em grande parte será descrito a seguir de forma semelhante, para se evitar perder muito da natureza metódica que possui.

Antes de entrar em atividade, uma unidade de exame forense deve definir sua política e desenvolver seus meios de ação. Primeiramente é preciso que o grupo decida suas principais funções e em qual das partes já citadas do processo vai atuar.

O modelo sugere uma série de protocólos que deveriam ser seguidos na formação dessa unidade de análise. Cabe destacar:

- Análise da viabilidade financeira da criação da unidade, levando-se em conta não apenas funcionários e equipamentos, mas também as instalações necessárias aos procedimentos e seus custos contínuos;

- Garantir profissionais capazes de lidar com as mais novas tecnologias e com as específicas da área de interesse. Cabe ao grupo optar entre o treinamento da equipe que possui ou a contratação de novos membros

- Determinar padrões para documentar e lidar com as evidências e também padrões básicos de operação, que servirão como referência para a maioria dos casos tratados.

A Avaliação de evidência é a primeira etapa a se lidar em um caso. Consiste em uma análise das informações iniciais sobre o caso - detalhes adquiridos até o momento , local onde se encontram as máquinas a serem avaliadas com suas epecificações, mandato de busca e suas limitações - a partir da qual são feitas as primeiras suposições, objetivando definir a natureza das evidências procuradas e a tomada das primeiras medidas.

Durante essa etapa do processo, devem ser considerados:

- Possibilidade de vestígios não digitais, que devem ser investigados por uma unidade capacitada para tal;

- Análise de vestígios digitais, como contas de email e logs do sistema;

- Documentação de todo tipo de tecnologia e sobretudo mídia disponível no local onde se localiza a máquina usada no crime;

- Condições necessárias para uma avaliação in-loco, assim como suas consequências para a equipe e para o estabelecimento onde ocorre;

- Natureza do equipamento onde foram deixados os vestígios e cuidados necessários para se garantir que nenhuma possível evidência contida neles seja perdida, sobretudo no caso de mídias físicas, como HDs e DVDs.

Após a aquisição de evidências, vem o processo de examiná-las, que se resume na inspeção dos dispositivos digitais encontrados no local em que o suspeito estava e na tentativa de se identificar evidências que comprovem que o crime ocorreu e que o conectem a esse suspeito. O modelo sugere dividir o exame em passos, que são:

- Preparação

- Copiar os arquivos encontrados todos para uma mídia separada, para que não se tenha que atuar nos arquivos originais.

- Extração

- A extração dos arquivos pode ser feita de forma física ou lógica, no primeiro caso os dados são extraídos sem relação com o sistema operacional em que estavam ou as aplicações em que atuavam, o que já não acontece no segundo.

No caso físico, são feitas buscas por posíveis palavras e arquivos específicos conectados ao crime, que pudessem não estar visíveis ao sistema operacional. No caso lógico os recursos do sistema operacional – recuperação de arquivos deletados, datas de modificação, detalhes dos arquivos contendo informações de quem os criou e os acessou - são usados para ajudar na apreensão de informações e evidências.

- Análise dos dados coletados

- após encontrar arquivos que possam ter conexão com o crime, deve ser feita uma avaliação para se considerar a pertinência deles na investigação

A comprovação de ligação com o crime pode vir de várias indícios, tais como: horas e datas de modificação e criação de arquivos que se interceptam com intervalos de tempo relevantes da investigação; arquivos escondidos que por si só já demonstram a inteção de conciliar informações e cujo conteúdo pode ser incriminador; informações de programas ou arquivos como nome, conteúdo e a quem foram registrados podem ligar o suspeito ao crime.

A partir do que foi obtido pelos meios sugeridos, pode-se fazer as conexões com o caso e buscar conclusões sobre a existência de prova ou não do crime.

A última parte da análise forense prevista pelo modelo é a documentação, que, na verdade, é um processo contínuo ao longo de todas as etapas anteriores. Devido à importância do detalhamento e da qualidade da documentação, o modelo sugere uma série de padrões, que podem ser resumidos em:

- Detalhar todas as informações legais e guardar todos documentos do caso;

- Descrever qualquer acontecimento durante a investigação, e todas as ações tomadas, de forma que pudessem ser replicadas se fosse necessário;

- Documentar tudo o que for possível sobre os dispositivos (tanto hardware quanto software) do suspeito, o local onde se encontravam e qualquer rede a qual pudessem ter tido acesso.

Devido a seu caráter pouco específico, o NIJ-DoD serve como guia válido para uma grande variedade de casos, mas ao mesmo tempo, pode se tornar uma referência muito vaga para alguns outros.

Baseado em Hipóteses

Carrier no trabalho [2] aponta que diversos modelos de investigação forense contam com problemas associados a incompletude. Assim, ele propõe uma abordagem similar, utilizando o método científico para a obtenção e análise das evidências da investigação. Ele propões 4 fases, sendo elas:

- Fase de observação - Fase onde a observação direta e indireta seria responsável por formular hipóteses. Deverá ser criada uma cadeia de custódia, assim como o estado do sistema deve ser preservado.

- Fase de formulação de hipótese - Fase onde através da interpretação dos dados encontrados, serão formuladas hipóteses de forma ordenada. Essas hipóteses deverão ser criadas com base nas características do incidente e do sistema.

- Fase da predição - Fase que identificará as evidências que sustentarão ou refutarão as hipóteses criadas anteriormente.

- Fase de testes - Fase onde são realizados testes de forma a avaliar as predições feitas anteriormente. Caso um teste sustente uma hipótese, é possível tirar mais conclusões sobre ela. Como a aquisição de dados não é precisa, a confiabilidade dos dados sempre deve ser considerada.

O propósito desse modelo parece ser associar o método científico das hipóteses com a forense digital, de modo a auxiliar em questões como a validade e a impugnação jurídica das evidências encontradas. Isso é possível através da aplicação de princípios científicos de forma mais trasnparente nos processos de investigação digital.

Embora o modelo facilite a identificação de suposições em uma hipótese, a complexidade dos sistemas envolvidos não permite a prova formal. Há casos em que a defesa alega que a evidência obtida foi plantada por meio de uma invasão ou malware.

Baseado em Camadas

Breno propôs em 2008[3] uma alternativa para os modelos existentes, usando camadas para diminuir a complexibilidade e facilitando a integração das informações entre elas. O modelo é fundamento na criação de estruturas de metadados e abstrações do ambiente digital, veremos mais detalhes a seguir.

Uma camada de abstração seria uma função que processaria a entrada aplicando um conjunto de regras, de forma a gerar um saída normalizada com uma margem de erro.

Nesse modelo, buscaremos interpretar a forense digital somente como mais uma camada do processo de interpretação dos dados, desta vez objetivando a prática da forense digital.

As ferramentas forenses serão tidas como programas para automatizar esse processo. O maior problema das ferramentas forenses é que não há um meio comum de troca de dados entre elas. Ou seja, a saída de uma ferramenta dificilmente servirá como entrada para outra. Assm, foi formalizado o Princípio da Homogeneização.

Todo processo forense em ambientes digitais pode ser reduzido a dados de entrada e saída esperados, independente de seu formato ou camada que atue.

Com base nesse princípio, Breno em seu trabalho criou mais uma camada no processo de forense digital, esta sendo chamada de Camada de Tradução, sendo ela responsável por transformar os dados disponíveis em dados de entrada em uma ferramenta forense qualquer.

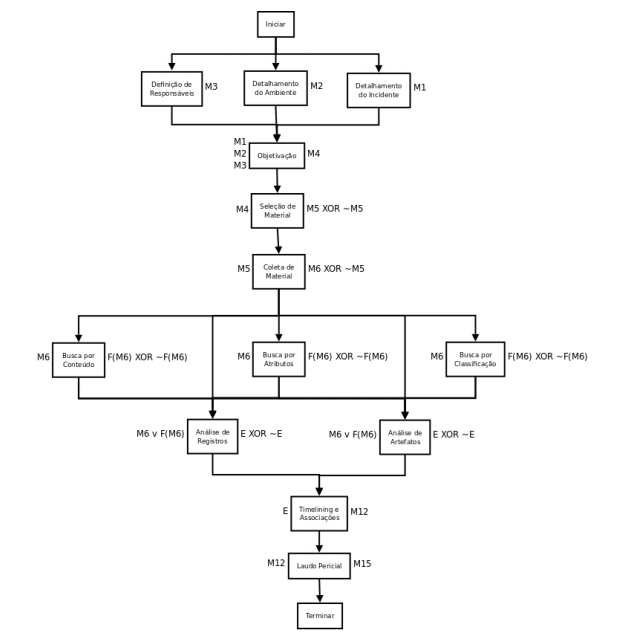

Para estabelecer o modelo foram criados 15 microprocessos. Na imagem a seguir, pode ser visto o plano para o modelo de microprocessos.

i

iPara finalizar, Breno em seu trabalho utiliza uma especificação em XML Schema de modo a sustentar a idéia de normalização, onde ele fornece diversos exemplos e até plugins de transformação para diversas ferramentas.

Por fim, essa abordagem é muito interessante por possibilitar o amazenamento em todas as etapas de todos os dados já encontrados, já que cada ferramenta passaria a usar somente as informações pertinentes para ela, deixando as outras sem modificação.

Outro ponto importante é que uma normalização dos dados permitiria uma maior facilidade na confecção do relatório forense. No caso apresentado, uma normalização em XML Schema permitiria inclusive a confecção de forma automatizada, assim diminuindo ainda mais a complexidade do processo de análise forense.